Nach dreitägigen Marathonverhandlungen haben die Unterhändler des Rates der Europäischen Union und des Europäischen Parlaments am 8. Dezember 2023 eine vorläufige Einigung über die vorgeschlagenen einheitlichen Regeln für künstliche Intelligenz erzielt.

Die jüngste Definition besagt, dass der Output eines KI-Systems nicht notwendigerweise auf ein von einem Menschen vorgegebenes Ziel ausgerichtet sein muss:

Wenn beispielsweise ein KI-Modell trainiert wird, wird das Endziel nicht explizit in der Programmierung angegeben, sondern der menschliche Entwickler motiviert die KI implizit, hohe Punktzahlen zu erzielen, indem er hohe Bewertungen/Belohnungen usw. vergibt.

Ein weiteres Beispiel ist, dass das KI-Modell, das für personalisierte Empfehlungen verwendet wird, die Präferenzen des Nutzers erst dann vollständig kennt, wenn diese Schritt für Schritt eingegrenzt und analysiert wurden, und der Entwickler des Modells kann und will dem KI-System keine expliziten Ziele vorgeben.

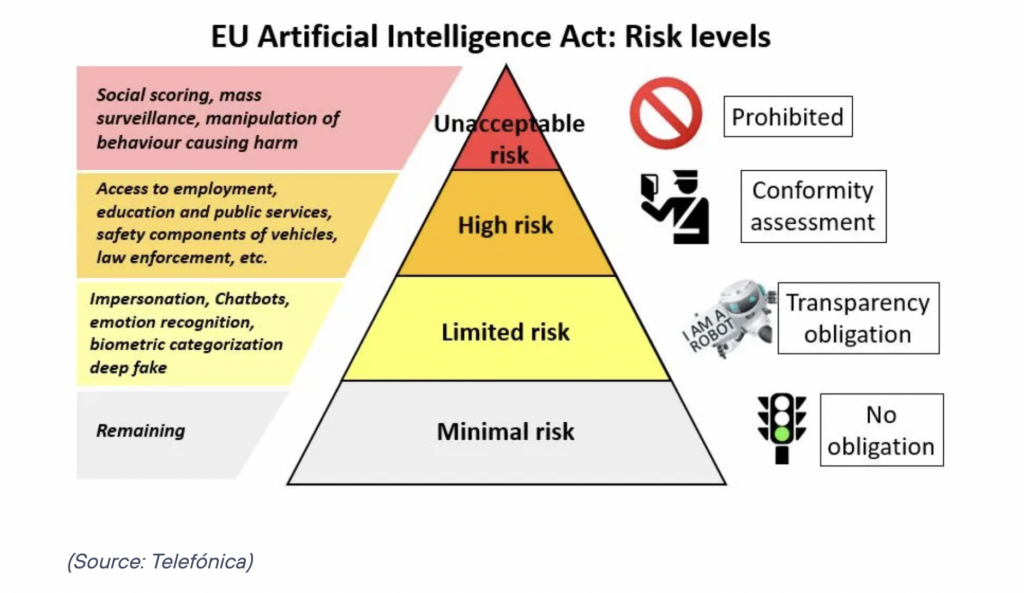

Verbotene KI-Verhaltensweisen

(i): Manipulation des kognitiven Verhaltens

Gemäß der vorgeschlagenen Gesetzesvorlage 2021 darf ein KI-System nicht in Verkehr gebracht, in einen Dienst integriert oder in Betrieb genommen werden, wenn das KI-System außerhalb des Bewusstseins einer Person mit einer unterschwelligen Technologie eingesetzt wird, die das Verhalten einer bestimmten Person in einer Weise beeinflusst, die dieser Person oder anderen Personen körperlichen oder seelischen Schaden zufügt oder zufügen kann. Offiziellen Berichten zufolge wird dieser Abschnitt auch in der Artificial Intelligence Bill 2023 beibehalten.

(ii): Ausnutzung der Schwächen einer bestimmten Personengruppe

Der Vorschlag von 2021 sieht vor, dass KI-Systeme, die auf Schwächen im Zusammenhang mit dem Alter, der Gesundheit oder dem geistigen Zustand abzielen und zu potenziellem Schaden führen, verboten werden.

Der Standpunkt des Rates der EU von 2022 erweitert dieses Verbot auf KI, die auf Schwachstellen im Zusammenhang mit dem sozialen oder wirtschaftlichen Status abzielt.

Für 2023 schlägt das Europäische Parlament ein Verbot von KI-Systemen vor, die Menschen nach sensiblen Merkmalen wie Geschlecht, Rasse und Religion einstufen. Jüngste Berichte deuten darauf hin, dass das KI-Gesetz 2023 im Einklang mit dieser Empfehlung steht.

(iii): Soziales Scoring

Der Vorschlag von 2021 verbietet es KI-Systemen, die Vertrauenswürdigkeit einer Person auf der Grundlage ihres sozialen Verhaltens oder ihrer Eigenschaften zu bewerten, wenn dies zu ungerechter Behandlung oder sozialem Schaden führt.

Im Jahr 2022 weitete der EU-Rat dieses Verbot auf private Einrichtungen und nicht nur auf Behörden aus.

Im Jahr 2023 strich das Europäische Parlament den Verweis auf öffentliche Einrichtungen aus seinem Text und schloss sich damit der Position des Rates an. Sowohl öffentliche als auch private Stellen fallen nun unter das Verbot von Social Scoring KI.

Die Pressekonferenz zum Entwurf der KI 2023 bestätigte diese Position, wobei die Europäische Kommission klarstellte, dass der Entwurf sowohl öffentliche als auch private Akteure umfasst. Die Veröffentlichung des endgültigen Textes wird jedoch darüber entscheiden, ob private Einrichtungen wie Unternehmen den gleichen Regeln in Bezug auf Social Scoring AI unterliegen werden.

(iv): Biometrische Fernidentifizierung

Die biometrische Identifizierung bestätigt die Identität einer Person anhand einzigartiger physischer oder physiologischer Merkmale. Sie kann eins-zu-eins (z.B. Entsperren eines Telefons) oder eins-zu-viele (Abgleich mit einer Datenbank) erfolgen.

Die Europäische Kommission betont, dass biometrische Systeme aufgrund der Risiken reguliert werden müssen. Schon eine Fehlerquote von 0,1 Prozent könne viele Menschen zu Unrecht inkriminieren.

Die Pressekonferenz zum AI Act 2023 deutet darauf hin, dass der Einsatz von biometrischer Fernerkundung in Echtzeit für die Strafverfolgung bevorzugt wird, insbesondere für Opfer von Straftaten, zur Abwehr von Bedrohungen oder zur Verfolgung von Schwerverbrechern.

Die Position des Europäischen Parlaments von 2023 geht jedoch über die verbotenen biometrischen Systeme hinaus: vorausschauende polizeiliche Maßnahmen auf der Grundlage von Profilen oder früherem Verhalten; unbefugte Sammlung biometrischer Daten aus Quellen wie dem Internet; Erkennung von Emotionen am Arbeitsplatz und in Bildungseinrichtungen; “verzögerte” biometrische Fernerkundung, außer mit richterlicher Genehmigung bei schweren Straftaten.

Während der Pressekonferenz zum KI-Gesetz wurden einige Verbote skizziert, die genauen Bestimmungen müssen jedoch noch offiziell dokumentiert werden.

“Hochrisikosysteme” der künstlichen Intelligenz

Der Vorschlag von 2021 sieht vor, dass KI-Systeme, unabhängig davon, ob sie als Sicherheitskomponenten in Produkten oder als eigenständige Produkte verwendet werden, einer Bewertung durch Dritte unterzogen werden müssen, bevor sie in Verkehr gebracht werden dürfen. Ein KI-System gilt als “risikobehaftet”, wenn es in den Geltungsbereich spezifischer EU-Rechtsvorschriften fällt, eine Konformitätsbewertung durch Dritte gemäß den EU-Vorschriften über die Produktsicherheit erfordert oder ausdrücklich als “risikobehaftet” eingestuft wird.

In den Fragen und Antworten der Europäischen Kommission vom Dezember 2023 wurde klargestellt, dass die Bestimmung des “Hochrisiko”-Status eines KI-Systems auf dessen Funktion, Verwendungszweck, den bestehenden EU-Vorschriften und einer vordefinierten Liste beruht. Die Kommission ist für die Aktualisierung dieser Liste zuständig. Während KI-Systeme, die Routinetätigkeiten ausführen oder menschliche Tätigkeiten unterstützen, ohne Entscheidungen zu beeinflussen, in der Regel nicht als risikoreich gelten, werden KI-Systeme, die Profile von Personen erstellen, immer als risikoreich eingestuft. Beispiele für risikobehaftete KI sind Systeme zur Überwachung kritischer Infrastrukturen, zur Filterung von Bewerbungsanträgen, und bestimmte biometrische Systeme, die alle strengeren rechtlichen Anforderungen unterworfen sind.

Darüber hinaus unterliegen Anbieter von “Hochrisiko”-KI-Systemen besonderen Verpflichtungen. Sie müssen eine Konformitätsbewertung durchführen, um sicherzustellen, dass ihr KI-System die Zuverlässigkeitsstandards erfüllt, z. B. in Bezug auf Datenqualität und Cybersicherheit. Bei wesentlichen Änderungen des KI-Systems ist eine erneute Bewertung erforderlich. Darüber hinaus sind die Anbieter verpflichtet, Qualitäts- und Risikomanagementsysteme zu unterhalten, um sich an die sich entwickelnden rechtlichen Standards anzupassen und die Risiken für die Nutzer zu minimieren. Behörden, die KI mit hohem Risiko einsetzen, müssen sich in der EU-Datenbank registrieren lassen. Steht das KI-System im Zusammenhang mit Strafverfolgung oder Einwanderung, muss es zusätzlich in einem vertraulichen Bereich der Datenbank registriert werden, der nur den zuständigen Aufsichtsbehörden zugänglich ist.

Weitere Highlights

Das KI-Gesetz 2023 schließt KI-Systeme aus, die ausschließlich für Forschung und Innovation genutzt werden, sowie solche, die von Einzelpersonen für persönliche, nicht berufliche Zwecke genutzt werden. Reuters berichtet, dass freie und quelloffene Software nicht unter das Gesetz fällt, es sei denn, sie wird als “hochriskant” eingestuft oder beinhaltet “verbotenes Verhalten”.

In den Fragen und Antworten der Europäischen Kommission wird jedoch betont, dass jedes KI-System, das in der EU auf den Markt gebracht wird oder Auswirkungen auf Personen in der EU hat, unter das Gesetz fallen könnte. Dies schließt sowohl öffentliche als auch private Stellen ein, von KI-Anbietern wie Entwicklern bis hin zu KI-Anwendern wie Banken, die diese Systeme kaufen.

Aufstrebende KI-Systeme wie etwa Plattformen des Typs ChatGPT, New Bing und Bard werden als “Allzweck-KI” anerkannt. Angesichts ihrer Vielseitigkeit und ihrer potenziellen Anwendungen auf verschiedenen Risikoebenen, einschließlich “hohem Risiko”, enthält der KI Act 2023 spezifische Bestimmungen für solche Systeme. Darüber hinaus plant die Europäische Kommission, ein Büro für künstliche Intelligenz einzurichten, das sich aus einem wissenschaftlichen Gremium unabhängiger Experten zusammensetzt und über KI-Systeme für allgemeine Zwecke beraten soll.

Hinsichtlich der Sanktionen sieht das Gesetz je nach Schwere der Verstöße erhebliche Bußgelder vor. Diese reichen von hohen Beträgen wie 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes (je nachdem, welcher Betrag höher ist) für “verbotene Handlungen” bis hin zu moderateren Geldbußen für Verstöße wie die Bereitstellung falscher Informationen. Es wird jedoch davon ausgegangen, dass die Strafen für kleine und mittlere Unternehmen (KMU) und Start-ups milder ausfallen könnten.

(Quelle: Europa, KI-Gesetz, Telefónica, Brookings, kom.de)